هشدار جدی خالق اتریوم درباره هوش مصنوعی؛ آیا این فناوری تهدیدی علیه بشریت است؟

به گفته ویتالیک بوترین، خالق اتریوم، هوش مصنوعی فوق پیشرفته اگر کنترل نشود، ممکن است از انسان پیشی بگیرد و به «گونه برتر» در سیاره تبدیل گردد. البته او معتقد است که این امر به چگونگی دخالت انسان در پیشرفتهای هوش مصنوعی بستگی دارد.

بوترین که به عنوان یک رهبر فکری در فضای ارزهای دیجیتال شناخته میشود، استدلال میکند که هوش مصنوعی با سایر اختراعات اخیر – مانند رسانههای اجتماعی، هواپیما، ماشین چاپ و غیره – تفاوت اساسی دارد؛ چون میتواند نوع جدیدی از «ذهن» را ایجاد کند که ممکن است علیه منافع انسان باشد.

بوترین میگوید که برخلاف تغییرات آب و هوایی، یک بیماری همهگیر یا جنگ هستهای ساخته دست بشر، هوش مصنوعی فوقهوشمند میتواند به طور بالقوه به بشریت پایان دهد، به خصوص اگر انسان را تهدیدی برای بقای خود بداند. وی افزود، در این صورت «حتی مریخ هم ممکن است ایمن نباشد.»

بوترین در ادامه به نتایج نظرسنجی اشاره میکند که در آگوست ۲۰۲۲ و در بین ۴،۲۷۰ محقق حوزه یادگیری ماشین صورت گرفت. بر اساس این نتایج، ۵ تا ۱۰ درصد احتمال داده میشود که هوش مصنوعی بشریت را نابود کند.

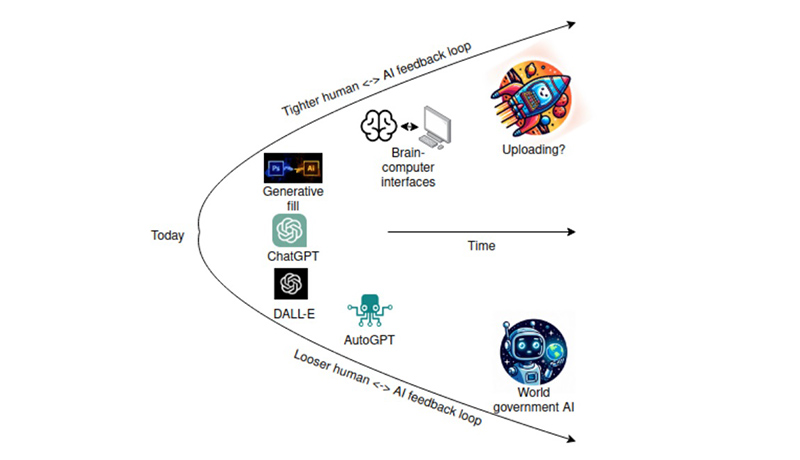

با این حال، بوترین تأکید میکند که راههایی نیز برای غلبه انسانها وجود دارد. برای این منظور، بوترین ادغام رابطهای مغز و کامپیوتر (BCI) را پیشنهاد میدهد؛ یک مسیر ارتباطی بین فعالیت الکتریکی مغز و یک دستگاه خارجی مانند رایانه یا اندام روباتیک.

بوترین میگوید که این امر، حلقه ارتباطی دو طرفه بین انسان و ماشین را از ثانیه به میلیثانیه کاهش میدهد و مهمتر از آن، اطمینان حاصل میشود که انسان «عملکرد معنیدار» خود را در سراسر جهان حفظ میکند. به گفته بوترین، این روش ایمنتر خواهد بود؛ زیرا انسانها میتوانند در هر تصمیمی که توسط دستگاه هوش مصنوعی گرفته میشود، مشارکت داشته باشند.

بوترین میگوید که این امر، حلقه ارتباطی دو طرفه بین انسان و ماشین را از ثانیه به میلیثانیه کاهش میدهد و مهمتر از آن، اطمینان حاصل میشود که انسان «عملکرد معنیدار» خود را در سراسر جهان حفظ میکند. به گفته بوترین، این روش ایمنتر خواهد بود؛ زیرا انسانها میتوانند در هر تصمیمی که توسط دستگاه هوش مصنوعی گرفته میشود، مشارکت داشته باشند.

دیدگاه خود را ثبت کنید